你可能感兴趣的试题

自变量间有较高的相关性 自变量与y间具有较高的相关性 各偏回归系数相同 y与各自变量的相关系数相同 y关于各自变量的回归直线相互重叠

都是随机变量; 都是自变量; x是随机变量,y是自变量; x是自变量,y是随机变量;。

在两个变量中须确定自变量和因变量 回归系数只能取正值 回归系数和相关系数的符号是一致的 要求两个变量都是随机的 要求因变量是随机的,而自变量是给定的

确定需估计推断的现象→确定影响待估计现象的主要因素→判定自变量与各因变量之间关系→设定回归模型→求解回归参数→对回归模型进行检验→根据相对最优原则确定回归模型→根据选定的回归模型进行估计与推断 确定影响待估计现象的主要因素→确定需估计推断的现象→判定自变量与各因变量之间关系→设定回归模型→求解回归参数→对回归模型进行检验→根据相对最优原则确定回归模型→根据选定的回归模型进行估计与推断 确定需估计推断的现象→确定影响待估计现象的主要因素→设定回归模型→判定自变量与各因变量之间关系→对回归模型进行检验→求解回归参数→根据相对最优原则确定回归模型→根据选定的回归模型进行估计与推断 确定需估计推断的现象→确定影响待估计现象的主要因素→对回归模型进行检验→判定自变量与各因变量之间关系→求解回归参数→设定回归模型→根据相对最优原则确定回归模型→根据选定的回归模型进行估计与推断

在相关分析中,相关的两变量都不是随机的 在回归分析中,自变量是随机的,因变量不是随机的 在回归分析中,因变量和自变量都是随机的 在相关分析中,相关的两变量都是随机的

回归分析可用于估计和预测 相关分析是研究变量之间的相互依存关系的密切程度 回归分析中自变量和因变量可以互相推导并进行预测 相关分析需区分自变量和因变量 相关分析是回归分析的基础

自变量是给定的,因变量是随机的 两个变量都是随机的 两个变量都是非随机的 因变量是给定的,自变量是随机的

回归分析可用于估计和预测 回归分析中自变量和因变量可以互相推导并进行预测 回归分析是相关分析的基础 相关分析是研究变量之间的相互依存关系和密切程度

回归分析可用于估计或预测 相关分析是研究变量之间的相互依存关系的密切程度 回归分析中自变量和因变量可以互相推导并进行预测 相关分析需区分自变量和因变量 相关分析是回归分析的基础

在回归分析中,若变量间的关系是非确定性关系,则因变量不能由自变量唯一确定 相关系数可以是正的也可以是负的 回归分析中,如果R.2=1,说明变量x与y之间是完全线性相关 样本相关系数r∈(-∞,+∞)

同一个问题 有联系但意义不同的问题 一般情况不是相同的问题 是否相同,视两相关变量的具体内容而定

自变量是给定的,因变量是随机的 两个变量都是随机的 两个变量都是非随机的 因变量是给定的,自变量是随机的

x是自变量,y是因变量 自变量是给定的,因变量是随机的 x与y的相关系数符号一定为正 两个变量是不对等关系 回归方程有两个

相关的两个变量都是随机的, 而回归分析中自变量是给定的数值, 因变量是随机的 回归分析中的两个变量都是随机的, 而相关中的自变量是给定的数值, 因变量是随机的 相关系数有正负号, 而回归系数只能取正值 相关的两个变量是对等关系, 而回归分析中的两个变量不是对等关系 相关分析中根据两个变量只能计算出一个相关系数, 而回归分析中根据两个变量只能配合一个回归方程

3个自变量回归系数检验中,应该至少有1个以上的回归系数的检验结果是显著的(即至少有1个以上的回归系数检验的P-Value小于0.05),不可能出现3个自变量回归系数检 验的P-Value都大于0.05的情况 有可能出现3个自变量回归系数检验的P-Value都大于0.05的情况,这说明数据本身有较多异常值,此时的结果已无意义,要对数据重新审核再来进行回归分析。 有可能出现3个自变量回归系数检验的P-Value都大于0.05的情况,这说明这3个自变量间可能有相关关系,这种情况很正常。 ANOVA表中的P-VALUE=0.0021说明整个回归模型效果不显著,回归根本无意义。

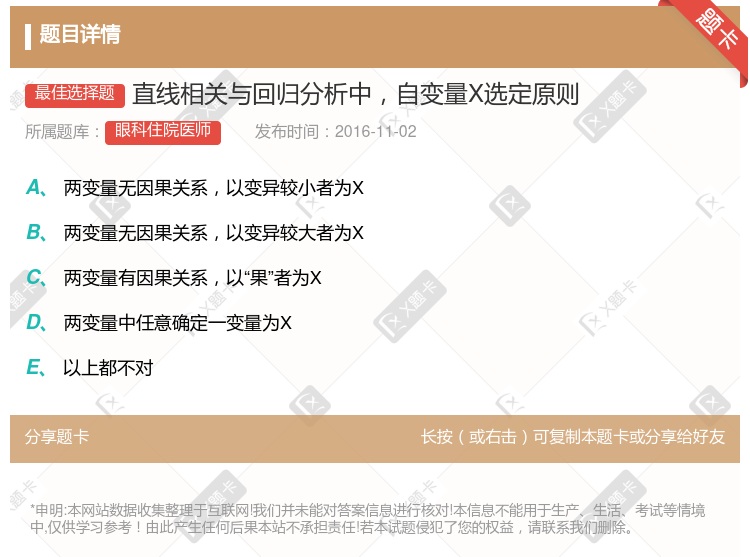

两变量无因果关系,以变异较小者为X 两变量无因果关系,以变异较大者为X 两变量有因果关系,以"果"者为X 两变量中任意确定一变量为X 以上都不对

自变量是可控制量,因变量是随机的 两个变量不是对等的关系 利用一个回归方程,两个变量可以互相推算 根据回归系数可判定相关的方向 对于没有明显因果关系的两个线性相关变量可求得两个回归方程

据同一资料,相关系数只能计算一个 据同一资料,相关系数可以计算两个 据同一资料,回归方程只能配合一个 据同一资料,回归方程随自变量与因变量的确定不同,可能配合两个 回归方程和相关系数均与自变量和因变量的确定无关